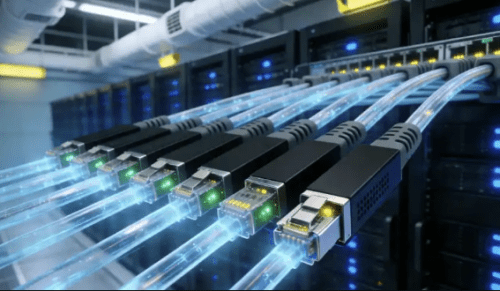

随着AI训练和推理规模不断扩大,数据中心网络正迎来新一轮带宽竞赛。近日,服务器与网络设备厂商 Celestica 正式开放DS6000系列交换机订单,这款产品最大的亮点,就是在单台设备中提供了64个1.6Tbps以太网端口,总交换容量高达102.4Tbps。

简单来说,这意味着AI集群内部的数据传输速度再次翻倍。此前业界主流还停留在800Gbps阶段,而现在1.6Tbps已经开始进入商用。

DS6000主要面向高性能计算场景,包括大模型训练、AI推理以及超大规模GPU集群。Celestica提供两种版本:一种是传统19英寸、3U风冷机箱;另一种则符合OCP开放计算标准,采用21英寸设计,并结合风冷与液冷方案,以满足高功耗AI机柜需求。

这款交换机的核心,是 Broadcom 的Tomahawk 6 ASIC芯片。该芯片最大的突破,在于首次支持200Gbps SerDes(高速串行接口)。每个1.6Tbps端口实际上由8条200Gbps链路组成,通过聚合形成超高速连接。

此外,交换机还支持breakout模式,也就是把一个高速端口拆分成多个较低速率接口,以提高网络灵活性和设备连接数量。

Celestica这次新品发布时间也相当巧妙,因为 NVIDIA 即将在今年推出支持1.6Tbps带宽的ConnectX-9网卡,并配套下一代Vera Rubin AI机架系统。不过,NVIDIA并没有直接开放单个1.6Tbps接口,而是采用双800Gbps链路设计,以提升冗余能力和网络路径稳定性。

另一边,AMD 也在推进高速AI网络。其未来的MI455X GPU平台,将搭配三块800Gbps Pensando Vulcano网卡,继续强化横向扩展能力。

不过,行业显然不会止步于1.6Tbps。Broadcom此前已经展示了支持400Gbps单通道的光DSP芯片,为未来3.2Tbps光模块铺平道路。

但现实问题也很明显:即便交换机和光模块速度不断提升,服务器内部总线仍然存在瓶颈。目前PCIe 6.0 x16接口理论上限约为800Gbps,这意味着未来很长一段时间里,网卡速度可能会受到主机接口限制。

换句话说,AI网络已经进入“谁先突破带宽墙”的时代。交换机、光模块、网卡甚至PCIe标准,都在同步向更高速度演进。而1.6Tbps,可能只是下一轮竞赛的起点。

苏公网安备32021302001419号

苏公网安备32021302001419号